Intelligenza artificiale. Governance, responsabilità e privacy: perchè serve una regolamentazione?

Secondo la definizione adottata dalla Commissione europea nel 2018, per intelligenza artificiale (IA) si intendono "sistemi che mostrano un comportamento intelligente analizzando il proprio ambiente e compiendo azioni, con un certo grado di autonomia, per raggiungere specifici obiettivi". Questi sistemi, caratterizzati da una diffusione rapida e pervasiva, impattano su tutte le attività umane con ricadute non solo sul piano tecnologico, ma anche giuridico, economico e sociale.

Molti Paesi hanno quindi cominciato a regolamentare aspetti e conseguenze dell'uso dell'IA, ma davanti alla velocità con cui le tecnologie evolvono, la formulazione di normative complete appare una sfida. E molte questioni restano aperte, come la protezione della privacy e dei dati personali, la tutela della proprietà intellettuale e dei prodotti dell'IA generativa, il rischio di profilazione dei giudici e l'avvento di una "giustizia predittiva".

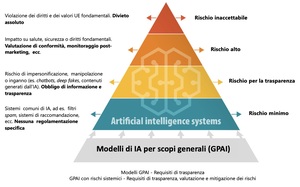

La Commissione europea, preoccupata che l'uso dell'IA possa "pregiudicare i valori su cui fonda l'Unione e causare violazioni dei diritti fondamentali", ha individuato i settori ad "alto rischio" e quelli a "rischio inaccettabile", disciplinandoli con un regolamento che, a livello globale, offre il quadro finora più complesso e completo. E l'Italia?

Artificial intelligence. Governance, accountability and privacy: why do we need regulation?

According to the definition adopted by the European Commission in 2018, artificial intelligence (AI) is defined as "systems that display intelligent behaviour by analysing their environment and taking actions - with some degree of autonomy - to achieve specific goals". These systems, characterised by rapid and pervasive diffusion, affect all areas of human activities with implications on the technological, legal, economic and social levels.

Many countries have therefore begun to regulate aspects and consequences of the use of AI, but faced with the speed at which technologies evolve, formulating comprehensive regulations appears to be a challenge. However, many issues remain open, such as the protection of privacy and personal data, the protection of intellectual property and generative AI products, the risk of profiling judges and the advent of 'predictive justice'.

The European Commission - concerned that the use of AI could "undermine the values on which the Union is founded and cause violations of fundamental rights" - has identified the sectors characterised by "high risks" and "unacceptable risk", and approved a regulation that, on a global level, offers the most complex and complete framework to date. And Italy?

Focus

Focus